“Private AI Compute”, Gemini en nube con privacidad local

Esta semana Google presentó “Private AI Compute”, una plataforma de procesamiento de IA que busca combinar Gemini en la nube con las garantías de seguridad y privacidad del procesamiento en local.

La idea es que Private AI Compute proporcione la velocidad y potencia de los modelos en la nube de Gemini para experiencias de IA, pero garantizando que los datos personales permanezcan privados para el usuario y no sean accesibles para terceros, ni siquiera para Google.

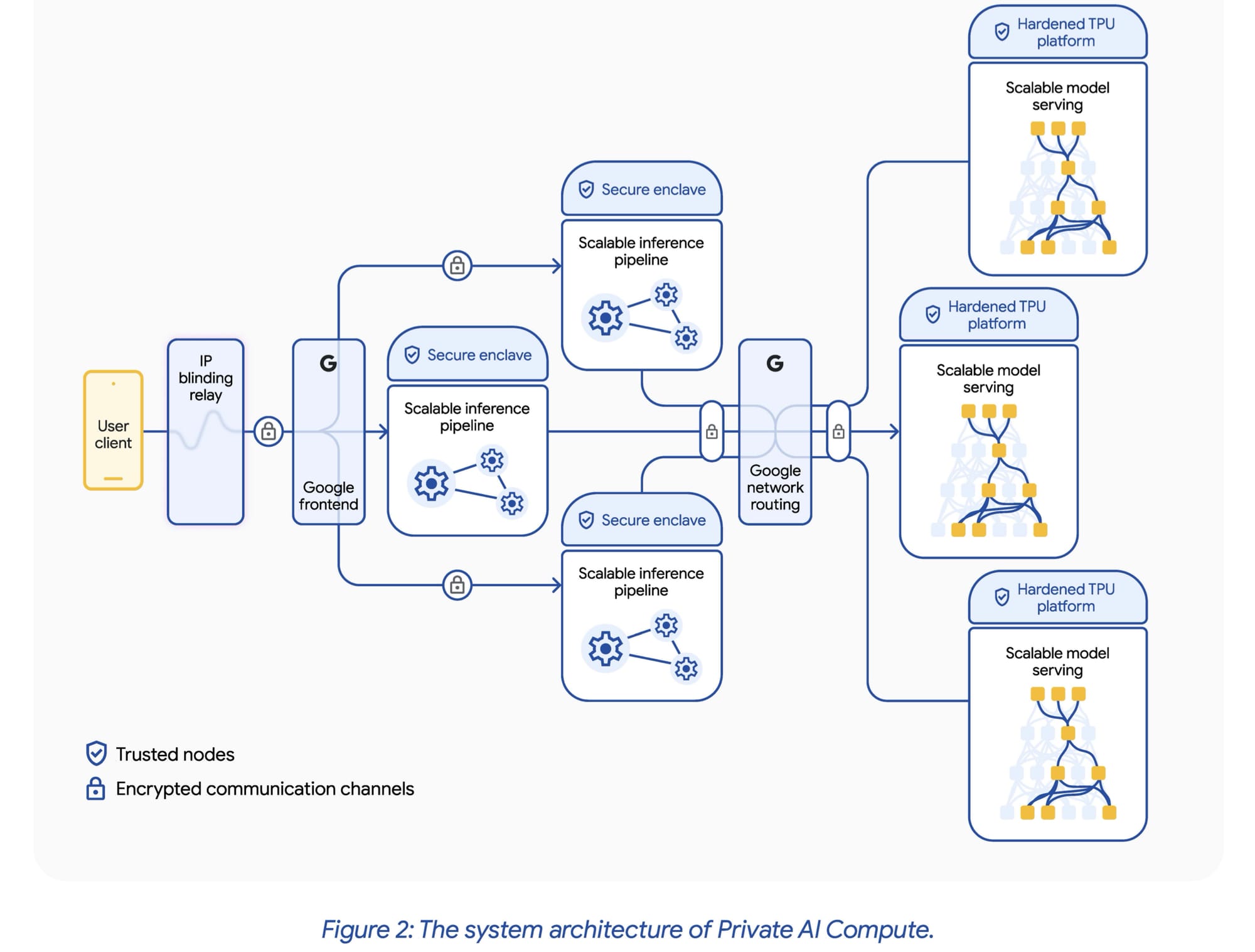

El briefing técnico detalla más su funcionamiento:

- Aprendizaje federado, cifrado punto a punto y modelo de privacidad diferencial.

- Múltiples niveles de capas y nodos aislados en su mayoría.

- Google solo ve estadísticas agregadas basadas en modelos de privacidad diferencial.

- Se aíslan los datos del usuario en máquinas virtuales para contener la potencial brecha en caso de un error, dificultando la exfiltración física con cifrado de memoria y protecciones de la unidad de gestión de memoria de entrada/salida.

- El sistema está diseñado para que las entradas, las inferencias del modelo y los cálculos solo se mantengan durante el tiempo necesario para cumplir con la consulta del usuario. Los atacantes no pueden acceder a datos pasados.

- Diseñado para que no sea posible el acceso administrativo a los datos del usuario.

- Antes de que se produzca cualquier intercambio de datos, los clientes establecen confianza con un punto final de Private Al Compute a través de la validación de la identidad de los servidores de punto final.

- Utiliza blindaje de IP para eliminar la capacidad de un atacante de vincular la dirección IP, o cualquier otra información de identificación de red, a su consulta específica.

- Aíslan la autenticación y autorización del sistema de la inferencia utilizando tokens anónimos. La autenticación del dispositivo y la limitación de velocidad son manejadas por un servidor separado, que intercambia las credenciales del dispositivo por un token anónimo y en caché para administrar el uso de todo el sistema.

Además, Google permite auditorías de privacidad y seguridad de terceros, tanto de los binarios del sistema y el código fuente. También han publicado el código para plataformas y funciones como Android, Private Compute Core, análisis federados confidenciales y su paquete de Machine Learning.

En definitiva, parece una apuesta seria por dar altos niveles de privacidad pero intentando mantener las ventajas del acceso en nube a los modelos más avanzados de Gemini.

Veremos la puesta en práctica qué tal funciona 🤖

Jorge Morell Ramos

Dicho esto, ahí va la actualidad del 29 de septiembre al 5 de octubre de 2025 en IA y Derecho (publicaré todas las semanas pendientes, las tengo recopiladas).

85 noticias sobre regulación, tribunales, propiedad intelectual e industrial, protección de datos, Legaltech y otras.