Cómo impedir que ChatGPT use tu imagen en su nuevo generador

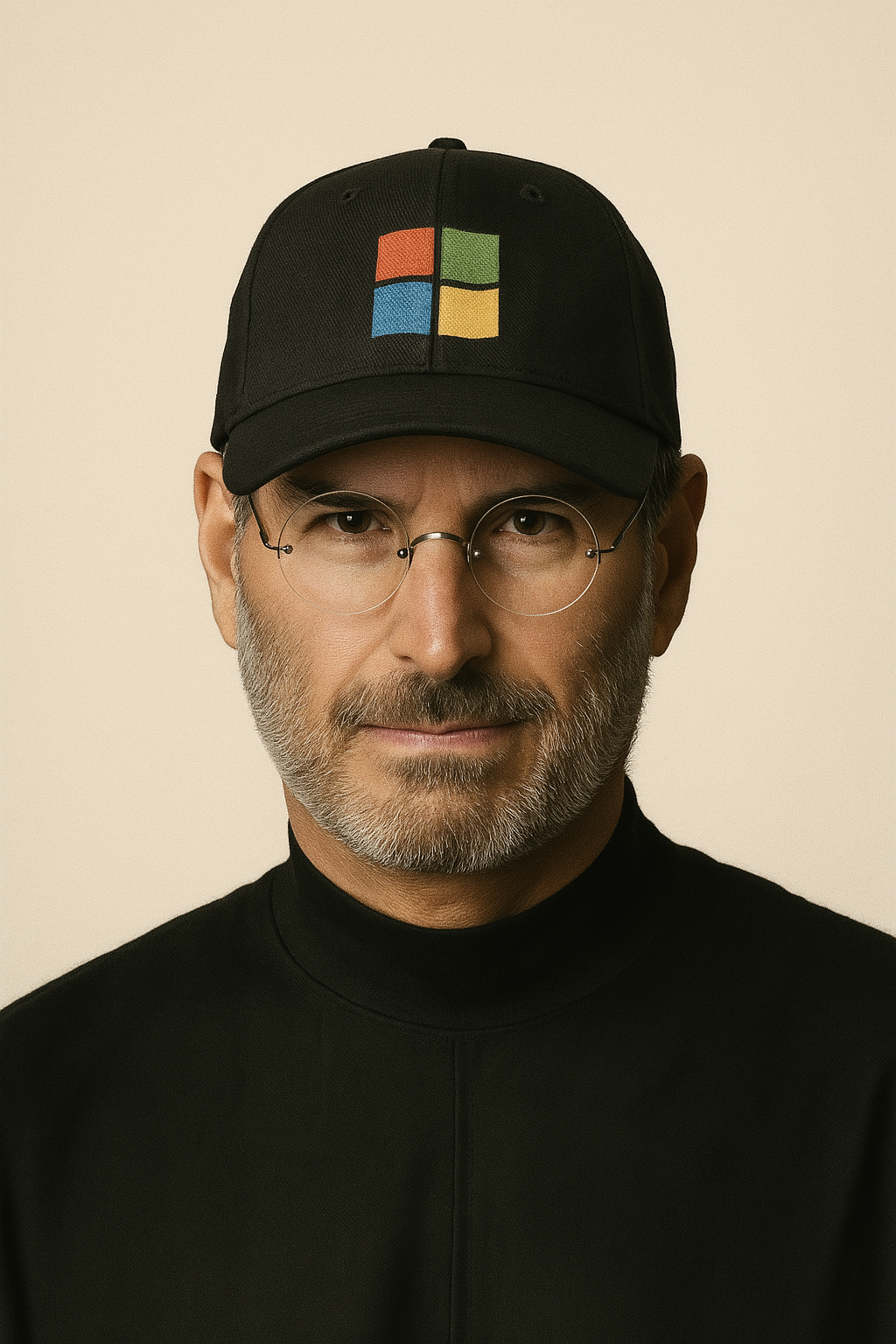

La semana pasada OpenAI lanzó al fin el generador de imágenes que sustituye a DALL-3, en el modelo GPT 4o, y la verdad es que revolucionó el patio en cuestión de horas.

Las posibilidades del nuevo generador son realmente avanzadas: imágenes muy realistas, múltiples estilos, capacidad de editar sobre imágenes, grandes avances en texto, etc.

Tal fue el éxito, que hasta tuvieron que aplicar limitaciones temporales ya que según Sam Altman “estaban derritiendo las GPUs”.

Una de las cuestiones que se viralizó fue la creación de imágenes con el estilo del estudio japonés de animación ”Studio Ghibli”, de Hayao Miyazaki, hasta el punto que se está ya analizando la potencial infracción de propiedad intelectual que eso supondría.

Sea como sea, lo que está claro (aunque OpenAI no especifica del todo) es que el nuevo generador ha bajado el listón en cuanto a las exigencias legales y de seguridad relativas a las imágenes que pueden generarse.

La letra pequeña de los cambios puede consultarse en el “Addendum to GPT-4o System Card: Native image generation”. Uno de los principales cambios es que a diferencia de DALL-E 3, el nuevo sistema permite crear imágenes de figuras públicas vivas o muerta.

Hay límites en relación a menores, contenido erótico, violento o actividades ilícitas. Pero a partir de ahí, vía libre.

De hecho, si le pides crear una imagen de alguien no famoso pero con presencia online, busca en Internet imágenes de esa persona y te pregunta si te refieres a la misma. Entonces te indica que el tipo de imagen que quieres crear no existe y lo ideal es que contrates a un diseñador gráfico, un dibujante o uses una IA para crear la imagen deseada. Además, que debes tener el consentimiento para tratar la imagen de esa persona.

Si le respondes que ésa es la persona y tienes su autorización, crea la imagen y le pone el nombre en la parte inferior. Otra cosa es que el parecido sea alto, ya que tiene poco muestro, pero va adelante.

Por ejemplo, yo le he pedido que cree una imagen del abogado español Jorge Morell Ramos con melena rubio platino. Me ha encontrado, me ha indicado todo lo dicho antes, le he contestado que ésa era la persona y que tenía su autorización y ha creado esto :p

Pero he probado con otros casos y ha conseguido imágenes más parecidas.

Por tanto, no es un cambio que se limite a personajes públicos, ya que insistiendo un poco puede llegar a trabajar sobre imágenes de anónimos que simplemente tienen un perfil en LinkedIn o Instagram.

Entonces, si soy figura pública, la represento legalmente o soy un anónimo que no quiere que puedan tratar mi imagen, ¿qué hago? Dice OpenAI que podrás excluir tu imagen del modelo, pero no dice cómo ni donde en ese documento. 🤔

De hecho, en mayo de 2024 OpenAI anunció que trabajaba en un Media Manager para identificar texto, imágenes, video y audio sujeto a derechos de terceros. Pero casi un año después, nadie sabe donde está.

Y viendo el interés de OpenAI en poder usar el contenido de terceros para sus modelos en la futura normativa IA de USA, quién sabe si llegará y cómo.

Aun así hay una vía para excluir el tratamiento de la imagen.

El muy escondido formulario para reportar contenido, incluye entre los motivos para ello “Public figure depiction” y “Unauthorized usage of likeness”. Además, especifica que en el caso de reportar contenido por “Public figure depiction”, debes ser la persona como tal o su representante autorizado.

Yo he solicitado a OpenAI que no permita usar mis imágenes online para crear deepfakes míos cn el nuevo generador, he rellenando el formulario, he indicado “Unauthorized usage of likeness” como motivo del envío y he argumentado una falta de consentimiento de acuerdo al RGPD, además de incluir ejemplos de las imágenes citadas en la respuesta.

Ya contaré a ver qué responden :p

Dicho esto, vamos con la actualidad de la semana.

NOTA: Como esta semana envío la newsletter fuera de plazo, es gratuita para todos, incluida la recopilación de noticias, no solo el tema principal. La semana que viene volvemos al calendario normal de martes a las 10:00 y al formato común (tema principal en abierto, actualidad semanal bajo suscripción).

Regulación

Virkkunen esboza plan de acción de IA: La Vicepresidenta Ejecutiva Henna Virkkunen ha dicho que la Comisión está planeando una Ley de Chips 2.0, y esbozó cinco pilares de un Plan de Acción Continental de IA que se presentará el 9 de abril. La UE también se está inclinando hacia el auge de la "acción" en IA, uniéndose al Reino Unido y EE.UU. con su propio plan de acción de IA, poco después de que la regulación pasara de moda en la Cumbre de Acción de IA en París. El colegio de comisionados decidirá sobre el plan de acción "Continente IA" el 9 de abril, dijo Virkkunen. Infraestructura, acceso a datos, una estrategia Apply AI, habilidades y simplificaciones serán los cinco pilares del plan. Inicialmente, la Comisión planeaba lanzar consultas sobre una estrategia Apply AI y una estrategia de IA en ciencia en febrero, pero estos planes fueron descartados ya que "hubo algunos anuncios más amplios que tuvieron que ser tenidos en cuenta de la Cumbre de IA de París", dijo un funcionario de la Comisión a Euractiv.

Información sobre la implementación de la Ley de IA proporcionada por la Comisión de la UE: La Comisión Europea actualizó estos días a los estados miembros de la UE sobre las próximas iniciativas para implementar la Ley de IA. En particular, la Oficina de IA proporcionó información sobre lo que se cubrirá en las directrices para IA de propósito general, esbozó una hoja de ruta para las directrices sobre sistemas de IA de alto riesgo, y detalló el proceso para el establecimiento del Foro Consultivo.

El nuevo gobierno de Alemania podría pedir revisión de la Ley de IA de la UE: El próximo gobierno alemán podría solicitar una revisión de la Ley de IA de la UE o, como mínimo, impulsar una implementación nacional de la ley que sea favorable a la innovación, minimice la carga administrativa y evite la fragmentación, según un borrador filtrado de los documentos de la coalición.

Proveedores de modelos de IA ven a legisladores de la UE expresar 'gran preocupación' sobre código de práctica: Los legisladores de la UE y el ministro que personalmente negoció la Ley de IA enviaron una carta a la Comisión Europea expresando "gran preocupación" sobre el código de práctica de la UE por hacer que las medidas de riesgo relacionadas con derechos fundamentales y democracia sean voluntarias. Más generalmente, los firmantes argumentan que la jerarquía de riesgos sistémicos introducida en la tercera iteración del código está en contradicción con la ley de IA.

Borrador del Código de Prácticas de IAAG de la Ley de IA de la UE amenaza objetivos, dice el sector creativo: El tercer borrador del Código de Prácticas de IA de Propósito General socava los objetivos de la Ley de IA, va contra la ley de la UE e ignora la intención del legislador de la UE, dijo una coalición de organizaciones de creadores y titulares de derechos en una declaración emitida hoy. Helen Smith, la presidenta ejecutiva de Impala, la asociación europea para sellos independientes, dijo "preferiríamos no tener ningún código en absoluto que tener este tercer borrador francamente inadmisible".

Legisladores italianos añaden requisito de localización de datos en borrador de ley de IA: Un decreto ley del gobierno italiano sobre inteligencia artificial fue adoptado por los legisladores en el Senado la semana pasada con una enmienda que obligaría a todos los sistemas de IA destinados a ser utilizados en el dominio público a estar basados en servidores ubicados en territorio italiano. Esta obligación de localización de datos, que podría entrar en conflicto con la ley de la UE y otras partes del texto, podría tener importantes implicaciones prácticas y económicas a menos que sea modificada por la otra cámara del parlamento italiano — un evento raro en el proceso legislativo del país.

El Consejo de Derechos Civiles de California avanza en reglas para prevenir discriminación por IA: El Consejo de Derechos Civiles de California ha votado para adoptar regulaciones destinadas a prevenir el sesgo en las decisiones de contratación por parte de empleadores que utilizan herramientas de inteligencia artificial. Las regulaciones ahora pasan a la Oficina de Derecho Administrativo del estado para su aprobación.

Holyoak de la FTC de EE.UU. pide vigilancia absoluta sobre fraude y competencia en IA: La comisionada de la Comisión Federal de Comercio de EE.UU., Melissa Holyoak, pidió a los encargados de hacer cumplir las leyes antimonopolio y de protección al consumidor que estén atentos a posibles problemas de competencia y fraude cuando se trata de inteligencia artificial, diciendo que es imperativo entender a los actores en el mercado.

Proyecto de ley de IA de alto riesgo de Virginia vetado por gobernador: Un proyecto de ley de Virginia estrechamente vigilado destinado a regular sistemas de inteligencia artificial de alto riesgo, e imponer sanciones civiles por incumplimiento, ha sido vetado por el gobernador republicano Glen Youngkin, quien dijo que perjudicaría a las pequeñas empresas. Los grupos empresariales ahora argumentan que el veto de Youngkin muestra que hay una creciente resistencia a la legislación estatal de IA, mientras que los defensores de los consumidores dicen que el proyecto de ley no fue lo suficientemente lejos para proteger a los residentes.

Kenia lanza Estrategia de Inteligencia Artificial (IA) 2025-2030: La Estrategia esboza una visión para que Kenia se convierta en el centro líder de IA de África para la innovación de modelos, impulsando el desarrollo sostenible, el crecimiento económico y la inclusión social, a la vez que se establece como líder en investigación y aplicación en el continente. La estrategia está anclada en tres pilares clave: infraestructura digital de IA, datos, e investigación e innovación en IA, y está respaldada por los siguientes facilitadores: gobernanza, desarrollo de talento, inversiones, ética, equidad e inclusión.

China y EE.UU. necesitan cooperar en IA, dice jefe del comité de relaciones EE.UU.-China: China y Estados Unidos necesitan cooperar en inteligencia artificial, y se podría evitar la duplicación de esfuerzos en el área, dijo el presidente del Comité Nacional sobre Relaciones Estados Unidos-China (NCUSCR).

La gobernanza de seguridad de IA es un enfoque clave para el regulador del mercado de China: El regulador del mercado de China planea establecer estándares de seguridad de datos dirigidos al etiquetado de datos de IA generativa y entrenamiento de optimización para asegurar todo el proceso de IA generativa, según Wang Qiuping, el portavoz del regulador en una rueda de prensa rutinaria. La iniciativa es parte de esfuerzos más amplios para crear estándares nacionales para la gobernanza de seguridad de IA. El regulador también mejorará los estándares para la clasificación de seguridad de IA, evaluación de madurez de capacidad, y gobernanza ética para asegurar un uso seguro y confiable de la tecnología de IA. Adicionalmente, la agenda incluye estándares para plataformas de potencia de cómputo, grandes modelos, inteligencia incorporada y agentes, productos de IA y usos industriales.

El Instituto de IA de China, BAAI, se opone a la inclusión en la lista de entidades de EE.UU.: La Academia de Inteligencia Artificial de Beijing de China, o BAAI, dijo que estaba sorprendida de ser añadida a la lista de entidades de EE.UU. como una institución de investigación científica sin fines de lucro privada, describiendo el movimiento como una "decisión equivocada sin ninguna base fáctica" e instando a las autoridades estadounidenses a retirarla. Según su declaración oficial, BAAI dijo que el movimiento del Departamento de Comercio de EE.UU. socavaba la innovación científica y la colaboración global en IA. BAAI estaba entre más de 50 entidades chinas añadidas a la lista por supuestamente buscar o intentar adquirir artículos de origen estadounidense para apoyar la modernización militar de China, efectivo el 25 de marzo.

Las grandes tecnológicas piden a Trump que luche contra la regulación de IA de la UE: EE.UU. debería "involucrar asertivamente a gobiernos extranjeros para disuadir la adopción de políticas de IA perjudiciales que debiliten el liderazgo estadounidense en IA", dice la carta abierta de las grandes tecnológicas.

Ley de IA de Corea del Sur genera tanto apoyo como preocupación de startups locales: Las startups de inteligencia artificial generativa de Corea del Sur han acogido con satisfacción la reciente promulgación de la ley de IA del país, sin embargo, las preocupaciones persistentes sobre la definición de la ley de sistemas de IA de alto impacto y las obligaciones aplicadas al contenido de IA generativa han templado un poco su optimismo sobre el potencial de crecimiento por delante. En una entrevista con MLex, Lee Se-young, el jefe de la Asociación de Startups de IA Generativa, pidió mayor apoyo gubernamental y orientación más clara sobre ciertas obligaciones antes de la implementación de la ley de IA.

Tribunales

OpenAI y Microsoft enfrentarán la mayoría de reclamaciones de derechos de autor de medios: Los gigantes tecnológicos OpenAI y Microsoft continuarán enfrentando reclamaciones por infracción de derechos de autor, ordenó el juez de distrito estadounidense Sidney H. Stein, en tres demandas que alegan que ChatGPT y Copilot de Microsoft se entrenaron ilegalmente con artículos protegidos de medios de comunicación, incluido el New York Times.

Medios solicitan fecha límite para que OpenAI aclare sobre preservación de datos: Los medios de comunicación están exigiendo que OpenAI identifique la 'naturaleza y extensión' de las conversaciones de usuarios supuestamente destruidas que podrían ser relevantes para su disputa de descubrimiento en litigio federal acusando a la empresa y a Microsoft de infracción de derechos de autor.

Juez recorta caso de derechos de autor contra Microsoft y OpenAI: Un juez federal de Nueva York mantuvo vivas las reclamaciones de infracción directa y contributiva de derechos de autor de organizaciones de noticias que acusan a Microsoft y OpenAI de apropiarse de su contenido para entrenar inteligencia artificial generativa mientras recortaba reclamaciones bajo la Ley de Derechos de Autor del Milenio Digital, pero dando a los demandantes la oportunidad de reelaborar sus alegaciones.

FIFA cita nuevas citas 'inexistentes' de abogados acusados de usar IA: El organismo rector internacional del fútbol presionó a un juez federal de Puerto Rico para sancionar a los abogados que lo acusan a él y a otros de intentar bloquear a rivales isleños, argumentando que al intentar refutar afirmaciones de que utilizaron inteligencia artificial que citaba casos inexistentes, los abogados introdujeron "nuevas citas defectuosas y citas inexistentes".

Abogados que demandan a la FIFA dicen que humanos, no la IA, cometieron errores de citación: Los abogados que acusan al organismo rector internacional del fútbol, su filial puertorriqueña y una asociación regional de fútbol de intentar bloquear a rivales locales dijeron a un juez federal de Puerto Rico que fue simplemente una supervisión humana, no el uso de inteligencia artificial, lo que llevó a inexactitudes de citación en recientes presentaciones.

'Potenciar' un algoritmo no es suficiente para justificar una reclamación por fijación de precios: Un juez federal de California dio poca importancia a las alegaciones de fijación de precios de acción de clase propuesta por los consumidores contra el proveedor de software SAS Institute Inc., que supuestamente creó un algoritmo de precios compartido que Hilton, Hyatt y otras cadenas importantes utilizaron para fijar y aumentar las tarifas de las habitaciones a nivel nacional.

Casos recientes destacan los últimos riesgos de litigios civiles relacionados con la IA: Las demandas en curso en tribunales federales de distrito revelan riesgos potenciales que las empresas que utilizan inteligencia artificial pueden enfrentar de litigantes civiles, incluidos casos de cobertura de seguros de salud que involucran reclamaciones contractuales y equitativas, y numerosos casos relacionados con reclamaciones de divulgación de valores, dicen los abogados de Katten.

Meta dice que usar libros de autores para entrenar IA es un uso justo: Meta Platforms ha instado a un juez federal de California a determinar que no violó la ley de derechos de autor al utilizar material de libros de más de una docena de autores para entrenar sus modelos de lenguaje grande llamados "Llama", diciendo que la disputa "presenta una cuestión de importancia existencial" para el desarrollo de la inteligencia artificial generativa en los EE.UU.

FTC de EE.UU. alcanza acuerdo de $17 millones con empresa de pagos con IA: Cleo AI, una empresa de anticipos en efectivo, acordó un acuerdo de $17 millones con la Comisión Federal de Comercio de EE.UU. por supuestamente engañar y defraudar a los clientes sobre cuándo pagaría los fondos y cuánto dinero podrían recibir los clientes en un corto período de tiempo. La aplicación también supuestamente dificultaba a los clientes cancelar suscripciones, y según el acuerdo la empresa debe cambiar los términos de sus cancelaciones.

NetChoice apoya sentencia contra leyes de contenido deepfake electoral de California: NetChoice dijo a un juez federal estadounidense que la ley de campaña electoral sobre "deepfakes" de California reemplazaría inconstitucionalmente las decisiones privadas de moderación de contenido de los sitios web con compulsión gubernamental para censurar el discurso político. Presentó un escrito en apoyo de un juicio sumario contra la ley. "El potencial de manipulación o error en la moderación del discurso político a instancias del gobierno aumenta considerablemente, ya que los moderadores corren el riesgo de suprimir inadvertidamente discursos que son críticos o satíricos, pero constitucionalmente protegidos contra la incursión gubernamental", argumentó.

Anthropic derrota moción de mandato preliminar de editores musicales: Un grupo de editores musicales ha perdido su moción para un mandato preliminar que bloquearía a Anthropic de usar letras de canciones para entrenar sus modelos de lenguaje grande, con un juez federal en San Francisco dictaminando que la medida cautelar solicitada corría el riesgo de ser demasiado amplia y que los editores no lograron demostrar una probabilidad de daño irreparable en ausencia de una medida cautelar. "La naturaleza indefinida del alivio buscado aquí arroja una larga sombra sobre la solicitud de los Editores", escribió la jueza de distrito estadounidense Eumi K. Lee al denegar la medida cautelar a Universal Music, Concord Music Group y otros editores. "El Tribunal no tiene discreción ilimitada para emitir una medida cautelar que puede ser demasiado amplia porque incluye obras para las cuales los Editores pueden no haber establecido propiedad o control".

Perplexity AI presenta respuesta para desestimación del caso de derechos de autor: Perplexity AI presentó una respuesta en apoyo de su moción para desestimar o transferir un caso de derechos de autor estadounidense presentado por Dow Jones & Co. y NYP Holdings. "El hecho de que, después de un número no revelado de intentos, el empleado de los demandantes supuestamente logró persuadir a Perplexity para proporcionar respuestas que los demandantes afirman que son infractoras no dice nada sobre si algún otro usuario, en Nueva York o en otro lugar, ha buscado o recibido las mismas o similares respuestas, y mucho menos que Perplexity haya dirigido a Nueva York de una manera que lo someta a jurisdicción personal específica para esta demanda", argumentó Perplexity.

La batalla de Musk contra OpenAI y Microsoft podría ir a juicio este año: La batalla legal de Elon Musk contra OpenAI y Microsoft por la fundación de la empresa detrás de ChatGPT podría avanzar hacia un juicio tan pronto como diciembre, sobre algunas reclamaciones no antimonopolio. Musk afirma que la "transformación perturbadora" de OpenAI en una entidad con fines de lucro violó sus compromisos caritativos originales con él "para desarrollar IA para el beneficio de la humanidad". OpenAI argumenta que las reclamaciones de Musk están impulsadas por quejas personales, no por violaciones legales. Mientras tanto, el Fiscal General de California, Rob Bonta, busca ser desestimado del intento de Musk de unirlo al caso, citando inmunidad soberana. Musk insiste en que el papel de Bonta es crucial debido a su supervisión de entidades sin fines de lucro como OpenAI.

Ex ingeniero de Google presenta respuesta sobre anulación de acusación por robo de secretos: El abogado de Linwei Ding presentó una respuesta en apoyo de la desestimación de una acusación que lo acusa de robar secretos comerciales de Google relacionados con la inteligencia artificial para beneficiar a empresas chinas. El abogado argumentó que las afirmaciones del gobierno son excesivamente especulativas. "El fracaso del gobierno en alegar hechos suficientes para establecer todos los elementos de un cargo de espionaje económico es la preocupación precisa que los legisladores tenían en mente al advertir contra el exceso de procesamiento. La Sección 1831 simplemente no se aplica cuando un individuo busca beneficiarse a sí mismo o a sus actividades comerciales privadas en un país extranjero", dijeron.

Propiedad Intelectual/Industrial

La tecnología informática y la IA lideran solicitudes de patentes europeas en 2024: La tecnología informática, que incluye innovaciones de inteligencia artificial como el aprendizaje automático, se convirtió en el campo más patentado para solicitudes de patentes europeas, según el Índice de Patentes 2024 publicado por la Oficina Europea de Patentes. La revisión anual muestra que en 2024, este sector vio 16.815 solicitudes de patentes, creciendo un 3,3 por ciento desde 2023. Samsung lideró las solicitudes de patentes en la OEP, recuperando el primer lugar de Huawei, que quedó en segundo lugar. LG, Qualcomm y RTX completaron los cinco primeros.

La JPO presume de velocidad récord en exámenes de patentes, iniciativas de IA en informe: La Oficina de Patentes de Japón publicó su informe de estado para 2025, destacando los logros de la JPO, incluida la reducción del tiempo de espera de examen de patentes a 14 meses, el establecimiento de Asesores de IA y la implementación de un sistema de no divulgación para solicitudes de patentes bajo la Ley de Promoción de Seguridad Económica. El informe enfatiza los esfuerzos de la JPO para mejorar la innovación y el crecimiento económico a través de exámenes de patentes eficientes, adaptación a nuevas tecnologías y cooperación internacional.

Estudio Ghibli contra OpenAI: ¿es esta la próxima demanda por derechos de autor en EE.UU.?: El nuevo generador de imágenes de ChatGPT 4o permite crear y trabajar con imágenes de forma muy fácil y potente. Y en menos de 24 horas se viralizó la (re)creación de imágenes con el estilo del estudio japonés Ghibli, de Hayao Miyazaki.

Juez incrédulo ante defensa planteada en lucha de marca registrada de OpenAI: Un juez federal de California dudó de ciertas defensas en la batalla de marcas registradas de OpenAI contra un hombre que dirige un sitio web llamado "open.ai", diciéndole al abogado del hombre repetidamente durante una audiencia que es "increíble" que esté afirmando que el tribunal no puede ordenarle legalmente transferir el dominio si no es dueño de la marca.

Autores buscan certificación de clase en caso de derechos de autor contra Anthropic: Varios autores que presentan reclamaciones de derechos de autor estadounidenses contra Anthropic por el entrenamiento de su inteligencia artificial pidieron a un juez federal que certifique dos clases de propuestas, una para obras de derechos de autor en general y otra para obras con derechos de autor que fueron copiadas por Anthropic.

Google y OpenAI pueden desestimar reclamaciones de ley estatal en disputa de PI: Un juez federal de California ha aceptado desestimar alegaciones hechas bajo las leyes de California y Massachusetts en demandas que afirman que Google y OpenAI copiaron videos de creadores de YouTube para entrenar modelos de lenguaje grande, mientras que los creadores han aceptado abandonar un caso similar contra Nvidia por completo.

Anthropic dice a juez estadounidense que la evidencia muestra que copiar libros para entrenar IA es un uso justo: La copia de libros de autores por parte de Anthropic para entrenar su modelo de lenguaje grande, Claude, es "transformadora en extremo", y un juez estadounidense debería encontrar que la práctica es justa sin ir a juicio, argumentó la empresa de inteligencia artificial en una moción para juicio sumario. Usar libros para entrenar a Claude sirve "un propósito fundamentalmente diferente de los libros mismos", argumentó Anthropic, y los autores no han producido ninguna evidencia de que hayan sido privados de un mercado para vender su trabajo porque no existe. "Los inmensos beneficios que Claude proporciona al público no han causado que una sola persona renuncie a comprar alguno de los libros de los Demandantes", dijo Anthropic.

Derechos de autor en IA debatidos en Corea del Sur en medio de intensificación de carrera global de IA: Los debates se están intensificando en Corea del Sur sobre cuestiones de derechos de autor mientras el país lucha por mantenerse al día con los líderes en la carrera global de IA, y en medio de una creciente presión sobre diversos interesados para lograr un equilibrio entre innovación y derechos de propiedad intelectual antes de que sea demasiado tarde. Estos debates están ocurriendo en línea con una tendencia global donde la innovación en IA evoluciona mucho más rápido y de manera más multifacética de lo esperado hace solo unos años. Los responsables políticos en Corea del Sur, como otras jurisdicciones, también están experimentando dificultades para decidir si, cuándo y cuánto reflejar el cambiante panorama en la ley o regulaciones.

Datos personales

El regulador de privacidad de Corea del Sur promete más apoyo para startups de IA: El regulador de privacidad de Corea del Sur preparará una guía sobre la adopción y utilización de IA generativa para ayudar a las pequeñas y medianas empresas y startup companies, dijo su director. Ko Hak-soo, presidente de la Comisión de Protección de Información Personal, hizo estas declaraciones durante una reunión programada con representantes de startups nacionales de IA. Mientras tanto, también reconoció la importancia de gestionar los riesgos relacionados con la información personal asociados con los modelos de IA basados en código abierto. Prometió aclarar aún más los estándares y requisitos de procesamiento de datos para que las empresas puedan utilizar más información de los usuarios para desarrollar y mejorar los servicios de IA.

Google implementa motor de búsqueda con IA generativa en países de la UE: Google dice que ha comenzado a implementar AI Overviews, su servicio de motor de búsqueda impulsado por IA generativa, en nueve países europeos. El servicio proporciona respuestas mejoradas basadas en los modelos de IA de Google, como Gemini 2.0, y se lanzó originalmente en EE.UU. en mayo del año pasado. Más tarde en el año estaba disponible en más de 100 países, incluido el Reino Unido para usuarios mayores de 18 años. La implementación en países de la UE se retrasó para garantizar el cumplimiento de las normas digitales de la UE y nacionales, incluida la protección de datos.

Preguntas rodean el modelo polaco de gobernanza de IA después de que se dejara fuera al vigilante de privacidad: La autoridad de protección de datos de Polonia fue recientemente excluida de la representación en el nuevo organismo encargado de la aplicación de la Ley de IA después de que pidiera participar como observador permanente para mantener su independencia. Pero el nuevo proyecto de ley para implementar la Ley de IA de la UE no aclara cómo asegurar la cooperación entre el nuevo organismo de IA y el vigilante de privacidad y así evitar enfoques regulatorios contradictorios e investigaciones paralelas. Se suma a un dilema de cumplimiento que otros estados de la UE harían bien en estudiar.

Nuevas reglas de China sobre reconocimiento facial buscan equilibrar seguridad, innovación: Los manejadores de información personal que utilizan tecnología de reconocimiento facial para procesar información en China se están preparando para nuevas regulaciones que gobernarán la gestión de seguridad de la tecnología, mientras las autoridades buscan equilibrar la seguridad con el desarrollo de la tecnología. Los reguladores de Internet y seguridad pública de China emitieron conjuntamente las medidas el viernes pasado, que entrarán en vigor el 1 de junio.

Legaltech

El plan del centro de computación de IA de Corea del Sur obstaculizado por la política: El intento recientemente anunciado de Corea del Sur de asegurar financiación fresca para acelerar y expandir el establecimiento planificado de un centro nacional de computación de inteligencia artificial corre el riesgo de retrasarse debido a un estancamiento político que dura más de lo que muchos esperaban, según un funcionario del gobierno. El Viceministro de Ciencia y TIC Song Sang-hoon dijo a MLex al margen de una conferencia que su ministerio ha estado preparándose para implementar rápidamente los planes una vez que se apruebe un presupuesto suplementario, pero que es incierto cuán pronto se finalizará el presupuesto debido a la "situación política nacional".

Guías y manuales

El uso de IA por parte del gobierno del Reino Unido está amenazado por datos de mala calidad: El uso de inteligencia artificial por parte del gobierno del Reino Unido está amenazado por tecnología obsoleta y conjuntos de datos de mala calidad, dice el Comité de Cuentas Públicas en un informe publicado estos días. El grupo parlamentario está pidiendo que un oficial digital senior sea incorporado en cada departamento del gobierno del Reino Unido para promover la adopción responsable de IA. El legislador conservador Geoffrey Clifton-Brown, presidente del comité, criticó lo que llamó "arquitectura digital francamente esclerótica" en Gran Bretaña, y cuestionó la viabilidad de los planes del gobierno para promover el uso de IA en el sector público.

En el ISMS Forum se presentó el documento sobre "Cláusulas contractuales en IA": Para desarrolladores, proveedores, integradores y demás.

Otros

El líder norcoreano dice que la IA y los dispositivos no tripulados son prioridad para las fuerzas armadas: El líder de Corea del Norte ha ordenado a su ejército hacer de la inteligencia artificial y el desarrollo de dispositivos no tripulados la máxima prioridad en la modernización de las fuerzas armadas del país, en una rara referencia directa al uso de IA en los sistemas de armas de Corea del Norte. Kim Jong Un dijo que el campo de los dispositivos no tripulados y la IA debería ser "priorizado y desarrollado" en la modernización de las fuerzas armadas, según la agencia oficial de noticias del país.

La IA, ciberseguridad y habilidades digitales recibirán 1.300 millones de euros de inversión de la UE: La Comisión Europea ha dicho que invertirá 1.300 millones de euros (alrededor de $1.400 millones) en inteligencia artificial, ciberseguridad y habilidades digitales. Estas inversiones, a través del Programa Europa Digital, se consideran estratégicamente importantes para la soberanía tecnológica del continente, y fueron adoptadas hoy en un programa de trabajo para 2025-2027.

Republicanos de la SEC de EE.UU. advierten contra regulación amplia por temores 'artificiales' de la IA: Los miembros republicanos de la Comisión de Valores y Bolsa de EE.UU. señalaron en una mesa redonda de la agencia que no están interesados en regular ampliamente la inteligencia artificial en la industria financiera, con la Comisionada Hester M. Peirce diciendo que ella y sus colegas no deberían sucumbir a los "temores artificiales".

Impulsadas por Trump, empresas de IA presionan por menos reglas: Después de que el presidente hiciera del dominio de la IA una prioridad máxima, las empresas tecnológicas (Meta, OpenAI o Google) cambiaron de curso desde un enfoque más tímido bajo la administración Biden.

La función de IA Intelligence retrasada de Apple desencadena solicitud de investigación en Corea del Sur: Apple enfrenta una solicitud de investigación de Seoul YMCA por presunta publicidad falsa relacionada con su función "Apple Intelligence" en dispositivos iPhone 16. El grupo de defensa del consumidor afirma que Apple comercializó prominentemente capacidades de IA que no estarán disponibles hasta 2026, engañando a los clientes para que compren los teléfonos. El grupo alega que la falsa representación de características importantes del producto causó un daño financiero significativo a los consumidores. Seoul YMCA ha pedido a la Comisión de Comercio Justo de Corea que investigue y potencialmente remita el caso a los fiscales, señalando que los infractores podrían enfrentar hasta dos años de prisión o multas de 150 millones de won (aproximadamente $102,000) bajo la ley de publicidad de Corea del Sur.

¡Hasta la próxima semana! 😄

Member discussion